Machine Learning arloan oso ohikoak diren bi arazori irtenbidea bilatzen saiatu dira UPV/EHUko ikerketa teoriko-praktiko batean. Lehenengoan, etiketatze ezaguneko datu gutxi izaten dira, eta ikasketa erdigainbegiratuan erabiltzen da, sailkapenak ongi egiten ikas dezan ordenagailuak. Bigarrena klase-desorekari dagokio: mota bateko datu etiketatu asko dago, eta oso gutxi, beste mota batzuetakoak, eta horrek eragiten du ereduek okerreko ondorioak ateratzea.

-

In memoriam: Arturo Muga

-

Violeta Pérez Manzano: «Nire ahotsa ijito bakar batengana iristen bada eta horrek inspiratzen badu, helburua bete dut»

-

In memoriam: German Gazteluiturri Fernández

-

Azukrea eta edulkoratzaileak. Zer jakin behar dut?

-

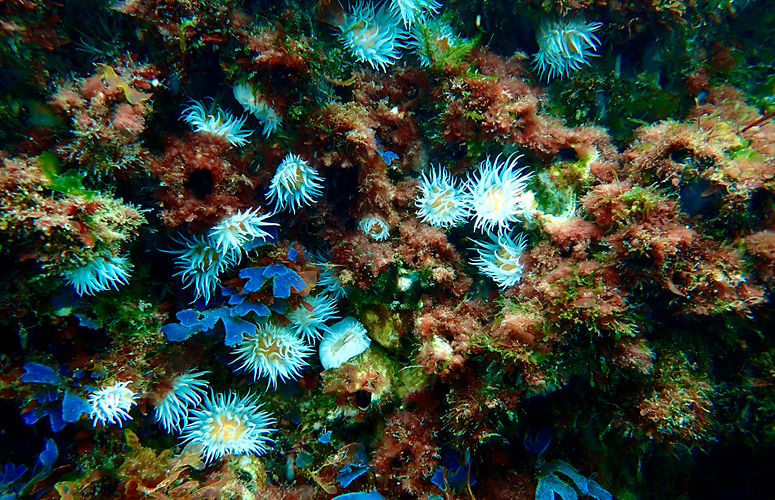

Itsasoaren gainazalaren tenperatura-igoerak aldaketa sakonak eragin ditu makroalgen komunitateetan

Irtenbide teorikoak, adimen artifizialean oso ohikoak diren bi arazorentzat

UPV/EHUko ikerketa batek aurrerapen garrantzitsuak egin ditu, datuetan oinarritutako ikasketa automatikoan izaten diren bi arazotan

- Ikerketa

Lehenengo argitaratze data: 2019/08/27

Jonathan Ortigosa informatika-ingeniariak UPV/EHUko Donostiako Informatika Fakultateko Konputazio Zientzia eta Adimen Artifiziala Sailean egin duen ikerketa Machine Learning edo ikasketa automatikoan oinarritzen da, zeina Adimen Artifizialaren adar ezaguna baita, eredu prediktiboen datu bidezko ikasketan oinarritzen dena batez ere. “Alor honetan aztertzen da nola eraiki ereduak, ematen zaizkien datuetatik ikasi eta iragarpenak egiteko gaitasuna izan dezaten”, zehaztu du ikertzaileak. Zehazki, sailkapen automatikoa izan du ardatz bere ikerlanean: “Alor honetan saiatzen gara datu asko erabiltzen, ordenagailuak haietatik ikasteko eta automatikoki sailkapena egiteko gai izan daitezen horretarako berariaz programatu gabe”, dio Ortigosak.

Ikertzailearen lanak alor horretan oso ohiko diren bi arazo izan ditu ardatz; “gaur egun komunitate zientifikoan erronka handiak dira, etengabe azaltzen baitira ikasketa automatikoari dagozkion problemetan”, erantsi du. Sentiment analysis edo sentimenduen analisiarekin lotutako lan batekin hasi zen. “Produktu jakin batzuen inguruko blog batzuetako artikuluak karakterizatzeko lan bat izan zen; jakin behar genuen ea testuak objektiboak edo subjektiboak ziren, balorazio positiboak edo negatiboak zituzten, etab.”, azaldu du. Baina ikertzaileek oso artikulu gutxi zeuzkaten ongi etiketatuta, ordenagailuak eredu sendoak ikas zitzan. Horregatik, “ikasketa-algoritmo berriak sortu behar izan genituen, etiketatu gabeko datu asko (Internetekoak) eta datu etiketatu gutxi erabiliko zituztenak; eta, hala, ordura arte baino emaitza hobeak lortu genituen”, dio Ortigosak.

Horren ondorioz, ikertzaileak jakin nahi izan zuen “zenbat datu etiketatu behar diren gutxienez aurrekoaren antzeko arazoak ebazteko”. Hala, gaiari buruzko ikerketa teorikoa eta matematikoa egin zuen, eta aztertu zuen “zein den datu etiketatu kopuru txiki jakin baterako proposa daitekeen algoritmo erdigainbegiratu egokiena, eta zer errore eragingo lukeen”. Horrekin kalkulatu zuten zein litzatekeen halako problema-motarentzat proposatzen den edozein algoritmorekin lor daitekeen errorerik txikiena, alegia, “jakin dezakegu ea datu-kopuru jakin bat nahikoa izango den ehuneko jakin bateko igartze-maila lortzeko. Orduan, proposatutako soluzioaren egokitasuna kalkula daiteke”, zehaztu du.

Ikerketan landu zuen beste arazoa klase-desorekarena da: “Haurrei txakurrak eta katuak bereizten erakusten zaien bezala irakasten zaie ordenagailuei. Baina txakur asko eta katu bakar bat erakusten badizkiegu, litekeena da haien arteko aldeak ondo ez ulertzea edo okerreko ondorioak ateratzea”, azaldu du Ortigosak. Nolanahi ere, ikertzaileak dionez, ikasketa automatikoan “eragin larriak izan ditzake enpresa batean ordenagailuak okerreko ondorio bat ateratzeak”. Horrenbestez, metrika bat proposatu zuten neurtzeko “ereduak ikasteko erabiltzen diren datuek zer desoreka-maila duten edo datuen etiketa-motetan zer alde dagoen. Desoreka-maila hori lotuta dago erabilitako datuen arabera proposa daitekeen soluzioaren errendimenduarekin”, erantsi du.

Hurrengo urratsean, zenbait metrika proposatu ziren ebaluatzeko ea desoreka-arazo baterako proposatzen den soluzio bat ona den edo ez. “Demagun 1.000 animalia ditugula, 999 txakur eta katu bat. Sortzen dugun soluzioak esaten badu animalia oro dela txakurra, % 99,9ko igartze-maila lortu dugu. Zenbakia oso ona da, baina soluzioa ez. Ebaluazio-metrika horri accuracy esaten zaio eta asko erabiltzen da Machine Learning-ean”, adierazi du. Soluzio “ergelak” ematen dituzten kasu horiek baztertzeko, azterketa teoriko bat egin zuten ikerketa honetan, “gomendatu ahal izateko kasu hauetarako zer ebaluazio-metrika diren egokienak eta, hala, soluzioen ebaluazio zintzo eta erabilgarria egin ahal izateko”.

Ortigosak adierazi duenez, arazoetako bakoitzari aplikatutako ikerketaz gainera, alegia, arazoen ebazpen praktikoa bilatzeaz gainera, ikerketa teoriko bat egin du: “Matematikoki modelatu ditut bi problemak, haiek kontrolatu ahal izateko, sakon aztertzeko eta informazioa atera ahal izateko, eta, gero, hori guztia benetako arazoetarako soluzioak proposatzeko unean erabiltzeko”, azaldu du ikertzaileak. “Benetako arazoak konplexuak dira, eta nahiz eta asko ari den ikertzen, jakintza teoriko handia behar da, orain dauden soluzioak baino hobeagoak proposatzen jakiteko”, esanez amaitu du.

Informazio osagarria

Jonathan Ortigosak (Donostia, 1985) doktore-tesia egin du (‘Theoretical and Methodological Advances in Semi-supervised Learning and the Class-Imbalance Problem’) Donostiako Informatika Fakultateko Konputazio Zientzia eta Adimen Artifiziala Sailean, Informatika Fakultateko katedradun, UPV/EHUko Intelligent Systems Group taldeko buru eta BCAMeko zuzendari zientifiko José A. Lozanoren eta Informatika Fakultateko irakasle Iñaki Inzaren zuzendaritzapean. Gaur egun, Gestampeko Fabrikazio Aurreratua eta Estandarizazioa saileko Analitika Aurreratua eta Adimen Artifiziala taldeko buru da Ortigosa.